NSSOL システム研究開発センター(シス研)では、3年先を見据え、先端技術をどのようにビジネスに活かしていくかを日々研究しています。そのシス研では今、有志が自主活動としてロボットを使ってより快適なオフィス環境を創造することに取り組んでいます。

自主活動の名は「Pepper部」。Pepperは言わずと知れたソフトバンクロボティクスが開発・提供する人型ロボットです。

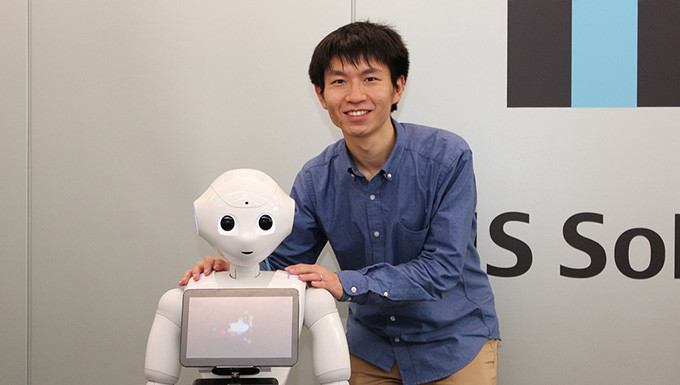

今回は、Pepper部の活動について古田裕介さんにお話を伺いました。

※注:Pepper部の取り組みは、ソフトバンクロボティクスのPepperを活用し、NSSOLが独自に実施しているものです。

―― Pepperってかわいいですね。

そうですね、もともとの機能で表現豊かに会話ができるので、シス研に初めてPepperが来たときも、Pepperに話しかけて会話を楽しむ人が多かったです。

―― ところでPepper部はどのような活動をしているのですか?

オフィスにロボットがいたらどのように人間を補助できるか、どんな働き方ができるのかということをテーマに、10人ほどの有志が業務終了後に集まり、ロボットの動かし方や、アプリの書き方を勉強しています。

―― 人間の補助というと、例えばどんなことでしょうか?

業務の中で自分の仕事に集中できるようにいろんな雑務を手助けしてくれたり、一部肩代わりしてくれたりして、人間は仕事に集中できる環境をつくれたらいいなと思っています。

―― コピーしてきて、と言ったらコピーをとりに行ったり?

そうですね。そういったことができると本当に嬉しいですね。

―― 他の企業でもオフィスでロボットを活用し始めているのですか?

それはあまり聞いたことはないですね。

―― こういう取り組み自体、まだ珍しいのですね。ところで、Pepper部のこれまでの活動成果は?

「Pepper宅配便」というのをつくりました。「○○さんに書類を届けて」とPepperにお願いすると届けてくれるというものです。

動画を見ていただいた方が分かりやすいと思いますので、ご覧ください。

―― こんなふうにPepperにお届け物をしてもらうと嬉しくなりますね。でも、一般的にPepperが歩いているイメージはあまりないですが。

ええ。Pepperは、どちらかというとコミュニケーションとかプレゼンテーションなどが得意で、自律歩行を前提にはつくられていないので、移動させること自体、大変でした。こんなに動けるPepperはこのPepperしかないと思います。

―― 自律歩行をさせようというアイディアは早い段階から出ていたのですか?

そうですね、何かさせようと思うと動かさないとならない仕事が多くて。その場に立っているだけだと完全に会話するアプリケーションになってしまうので、それだと画面に向かって話しているのとそんなに変わらない。そこはせっかく動くんだから動かしたいと。

―― なるほど。自律歩行させるのにどういう点が大変でしたか?

遠くまで歩こうとすると、Pepperが地図情報を頼りに自分がどこにいるのかを認識しないと、迷子になってしまいます。ロボット用の基盤ソフトウェア「ROS(Robot Operating System)」を使ってPepper自ら地図を作成できるようにし、その地図上での自分の位置を認識してオフィス内を移動できるようにしました。

ウエスト部分に設置したセンサーが感知した情報で壁までの位置などを判断し、通路の中央を進むようにしています。ノートパソコンを携帯させて、ここで情報処理しています。

―― Pepperがあらかじめ持っていた機能では難しかった?

Pepperの目の部分にも、もともとセンサーはついていますが、地図をつくれるほどの精度を想定していないセンサーで、なおかつ、かわいらしい目を演出する丸いプラスチックがセンサーの外側を覆っているので正確に距離が測れなかったんです。そこで別途電源を必要とせずコンパクトな外付けのセンサー(Xtion PRO LIVE)を付けることにしたのですが、どこに付ければ一番正確なデータがとれるか試行錯誤しました。当初はPepperの頭につけようとしたんですが、右を見たり左を見たりするのでぐらぐら動いてしまうし、足元の障害物も見えにくい。最終的にこのように胸に付けたら安定しました。

あとは、モーターがどのくらい回転したかで、自分が前に進んだり、90度回転したといった情報がとれるのですが、その精度もあまり良くなくて、回転量に補正をかけて修正したり、使うソフトウェアを少し変えることで克服しました。

ほかにも、ソフトウェアのいろんな項目のパラメータを調整しなければならず、例えば移動量の誤差を補正するため数値をちょっと変更すると今まで動いていたところが動かなくなってしまったり・・・。移動速度も速すぎると壁に突っ込んでしまったり、自分がどこにいるのかわからなくなってしまうので、最適な速度を決めました。また、狭いところはゆっくり移動させるといったきめ細かい設定にしました。

―― そうした試行錯誤の過程で新たに発見したことはありますか?

地図の自動作成を行う際、移動は人の操作で行っています。最初は移動精度が良くないせいで地図の自動作成もきれいにできず悩んでいました。ところが、人間がだんだんコツをつかんできて、通路の角などの特徴がある位置を見続けることで少々精度が悪くて誤差があってもうまく補正できるということがわかりました。平面の壁だけ見ていると特徴がないので自分がどこまで動いたかはっきりしません。一方、角を見ていると、その角に対してどのくらい動いたかという情報がとれやすいわけです。

そのため、特徴があるところを見ながら移動するようにPepperを操作して、地図の自動作成をおこなっています。本当は一続きでフロアを1周してすべて自動で1枚の地図ができればいいのですが、範囲が広すぎると綺麗な地図を作るのが難しいため、現在は個別に複数の地図をつくってそれを人の手で後からつなげて大きな地図にしています。

―― この自律歩行をするPepperは、いまシス研でどんな仕事をしていますか?

宅配便のほかにも、シス研内の飲み会の告知を触れ回ってもらっています。フロアを移動しながら音楽を流したり話したりして、飲み会があることをアナウンスするというお仕事です。

―― Pepperに飲み会に誘われたら行きたくなりますね。

はい、やはりそこがヒト型ロボットの持ち味と言えるかもしれません。ただ画面に向かって話しかけるのと、人っぽい形をしているロボットに話しかけるのでは人の心理面でも何か違う気がします。そこを突き詰めていくと、いろんな使い方が見えてくるかもしれませんね。

―― 古田さんは、いつ頃からロボットに興味を持ったのですか?

学生時代ゲームのプログラミングが楽しくて大学は情報系の学部に入ったのですが、研究室を選ぶ段階でロボットや画像認識や生物系などの研究室もあって、そうした研究室を見た時に、モノが動くのが面白いなと思って。それでロボットの研究室を選びました。

―― どういう研究をしていたのですか?

ロボットに家事支援をさせる研究です。人間が指示をして箒で掃いてゴミを集めるとか、テーブルを拭くとか。そういう動作を人間が画面で操作して教えるのですが、それをどう教えたらいいかといったことです。

―― これからロボットはどんなふうになっていたらいいと思いますか?

自分の分身のように歩いている感覚が伝わったり、遠くにいても実際にそこにいるような感覚で作業したり人に会うことができるようなロボットができたらいいな、と思っています。

Pepper部として、また新たに何かできれば報告したいと思います。

―― はい、楽しみにしています!